PixArt-Σ是什么

PixArt-Σ是由来自华为诺亚方舟实验室、大连理工大学和香港大学的研究人员推出的一个基于扩散Transformer架构(DiT)的文生图模型,专门设计用于从文本提示直接生成可达4K分辨率的高质量图像。该模型是在PixArt-α的基础上,通过整合高级元素和采用由弱到强式训练方法得到的更加强大的模型,不仅提高了生成图像的保真度,还改善了图像与文本提示之间的对齐程度。PixArt-Σ的生成图像在美学质量上与当前顶级的文本到图像产品不相上下,如DALL·E 3和Midjourney V6,并且在遵循文本提示方面表现出色。

PixArt-Σ的官网入口

- 官方项目主页:https://pixart-alpha.github.io/PixArt-sigma-project/

- GitHub代码库:https://github.com/PixArt-alpha/PixArt-sigma(源码和模型待上线)

- arXiv研究论文:https://arxiv.org/abs/2403.04692

PixArt-Σ的功能特性

- 4K分辨率图像生成:PixArt-Σ能够直接从文本提示生成3840×2160分辨率的高清图像,无需后续处理或其他软件的介入。

- 文本到图像的高保真转换:模型在生成图像时,能够精确地遵循文本描述的内容,确保图像与文本之间的高度一致性。

- 高效率训练:PixArt-Σ采用了“弱到强训练”的策略,通过引入高质量数据和高效的令牌压缩技术,显著提高了训练效率。

- 较小的模型尺寸:尽管PixArt-Σ能够生成高分辨率的图像,但其模型参数量相对较小(0.6B参数),这使得模型更加高效且易于部署。

PixArt-Σ的工作原理

PixArt-Σ的工作原理基于DiT(Diffusion Transformer)架构,这是一种结合了扩散模型和Transformer架构的深度学习方法,专门用于将文本描述转换成相应的图像。以下是PixArt-Σ工作原理的详细介绍:

1. 预训练阶段:

在预训练阶段,PixArt-Σ使用了大量的文本-图像对来学习文本和图像之间的关联。这个过程通常包括以下几个步骤:

- 文本编码:首先,输入的文本描述通过文本编码器(如Flan-T5)转换成一系列token的嵌入表示。在PixArt-Σ中,为了处理更复杂的描述,文本编码器的token长度被扩展到了大约300词。

- 条件特征提取:接着,这些文本嵌入与图像的条件特征一起被送入扩散模型。条件特征提取器通常是一个预训练的神经网络,用于从文本嵌入中提取与图像生成相关的特征。

- 扩散过程:扩散模型通过模拟一个从数据分布逐渐添加噪声的过程来学习数据的分布。在训练过程中,模型学习如何从带有噪声的数据中恢复出清晰的图像。

- 迭代细化:通过迭代过程,模型逐渐学习如何根据文本描述生成高质量的图像。这个过程涉及到调整模型参数,使得生成的图像与真实的图像越来越接近。

2. 由弱到强式训练:

PixArt-Σ采用了由弱到强式训练策略,这意味着模型首先在较低质量的数据集上进行训练,然后逐步引入更高质量的数据集和更复杂的训练策略。这种方法有助于模型在有限的资源下有效地利用新数据和算法来增强性能。

3. 高质量训练数据集(Internal-Σ):

PixArt-Σ使用了一个新的高质量数据集,这个数据集包含了高分辨率的图像和密集且准确的描述。这些数据为模型提供了丰富的视觉信息和文本信息,有助于提高生成图像的质量和与文本描述的对齐程度。

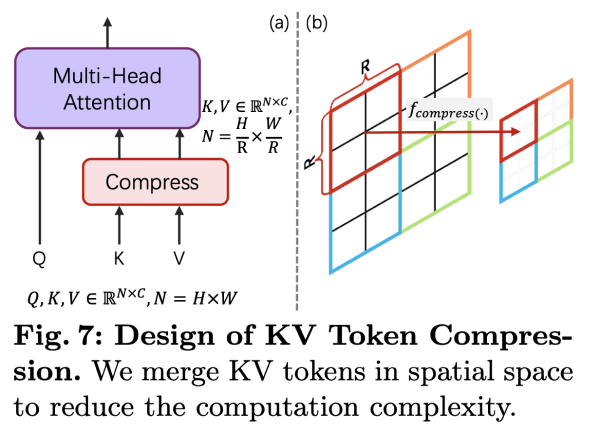

4. 高效的token压缩和权重初始化:

为了生成高分辨率图像,PixArt-Σ引入了键和值token的压缩技术,以及专门设计的权重初始化方案。这些技术使得模型能够有效地处理高分辨率图像的生成,同时减少了计算资源的需求。

5. 微调技术:

在微调阶段,PixArt-Σ通过替换更强大的变分自动编码器(VAE)、从低分辨率到高分辨率的扩展,以及从不使用KV压缩到使用KV压缩的模型演进,进一步提升了模型的性能。

6. 生成阶段:

在生成阶段,用户输入文本描述,模型根据学到的文本-图像关联,通过迭代过程逐步生成与描述相匹配的图像。生成的图像会根据文本描述的内容、风格和细节进行调整,以确保最终输出的图像既美观又准确地反映了文本的意图。